为什么说伦理道德是AI面临的最大挑战之一?

为什么说伦理道德是AI面临的最大挑战之一?

2017-03-17 10:39:59 来源:网易科技 抢沙发

抢沙发

2017-03-17 10:39:59 来源:网易科技

摘要:据BBC报道,人工智能(AI)几乎已经无所不在,我们生活的大多数方面都已经被它们渗透,从我们决定看什么书、预定哪个航班、在网上买什么、工作申请是否成功、是否收到银行贷款甚至如何治疗癌症等。

关键词:

伦理道德

AI

据BBC报道,人工智能(AI)几乎已经无所不在,我们生活的大多数方面都已经被它们渗透,从我们决定看什么书、预定哪个航班、在网上买什么、工作申请是否成功、是否收到银行贷款甚至如何治疗癌症等。所有这些东西,现在都可以利用复杂的软件系统自动确定。随着AI在过去几年取得的令人震惊的进步,它在许多方面都可能帮助我们的生活变得更美好。

在过去2年中,AI的崛起已不可阻挡。大量资金被投入到AI初创企业中,许多老牌科技公司(包括亚马逊、微软以及Facebook等巨头)都已经开设新的研究实验室。可以毫不夸张地说,现在软件就意味着AI。有些人预测,AI即将带来巨变,其影响甚至超过互联网。

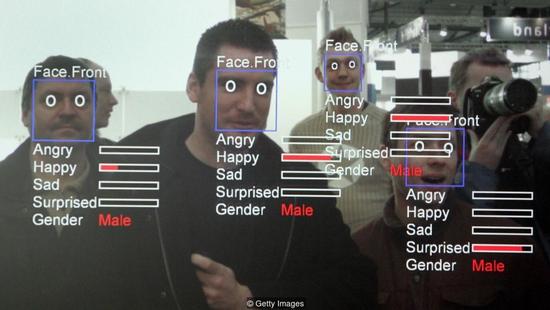

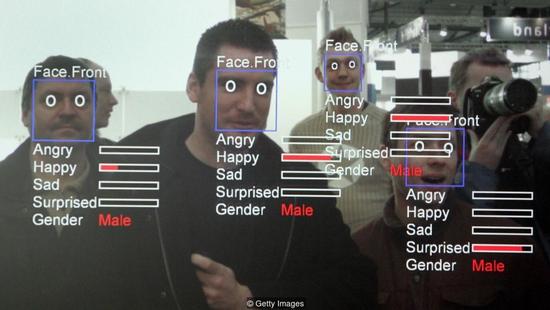

图:人工智能已经在许多实际任务中证明自己的价值,从标记图片到诊断疾病等

我们已经询问多名技术专家,在这个快速变化的世界,充满无数辉煌机器会对人类产生什么样的影响。值得注意的是,几乎所有人的回答都围绕着伦理道德为中心进行。对于谷歌研究主管、机器学习先驱彼得·诺维格(Peter Norvig)来说,数据驱动的AI技术最近取得许多成功,关键问题是找出如何确保这些新系统能够改善整个社会,而不仅仅是控制它的主体。诺维格表示:“AI已经在许多实际任务中证明自己的价值,从标记图片、理解语言到帮助诊断疾病等。现在面临的挑战是,确保每个人都能从这种技术中受益。”

最大的问题是,软件的复杂性经常意味着,想要精确地解释AI系统为何做出那样的决定几乎是不可能的。今天的AI主要基于名为机器学习的成功技术,但你无法揭开它的盖子,透视其内部工作场景。为此,我们只能选择相信它。挑战也随之而来,那就是我们需要在许多领域找到新的监控和审核方式,特别是AI正发挥重要作用的领域。

对于哈佛法学院互联网法律教授乔纳森·斯特兰(JonathanZittrain)而言,这其中的一大危险就是,日益复杂的计算机系统可能阻止自己受到必要的审查。他说:“在技术帮助下,我们的系统变得越来越复杂,我很担心人类的自主性被减少。如果我们设置了系统,然后将其忘诸脑后,系统的自我演变带来的后果可能让我们后悔莫及。对此,目前还没有明确的道德层面上的考虑。”

图:人工智能将让机器人从事更复杂的工作,比如日本这种购物助理机器人正为顾客服务

这也是其他技术专家担忧的地方。美国杜克大学下属人类与自主实验室主任米塞·卡明斯(MissyCummings)质疑道:“我们怎样才能证明这些系统是安全的?”卡明斯曾是美国海军首位女战斗机飞行员,如今是无人机专家。

AI的确需要监管,但现在我们还不清楚如何对其进行监管。卡明斯说:“目前,我们还没有被普遍接受的方法,也没有测试这些系统的行业标准。对于这些技术来说,实施广泛的监管非常困难。”在快速变化的世界中,监管机构常常发现自己也对此束手无策。在许多关键领域,比如刑事司法系统和医疗领域,许多公司已经使用AI探索做出假释决定或疾病诊断的尝试。但是将决定权交给机器,我们可能会失去控制权,谁能保证机器在每个案例中都能做出正确决定?

微软研究院首席研究员丹娜·博伊德(DanahBoyd)说,有关价值观的许多严重问题正被写入这些AI系统中,最终谁将为此负责?博伊德称:“监管机构、民间社会以及社会理论学家们日益渴望看到这些技术能保持公正和道德,但这些概念都很模糊。”

一个充满道德问题的领域就是职场。AI将帮助机器人从事更复杂的工作,并导致更多人类工人被取代。举例来说,中国富士康公司计划利用机器人取代6万名工人。福特在德国科隆的工厂也投入机器人,与人类工人协调工作。

图:在许多工厂,人类工人已经开始与机器人共同工作。有些人认为,这可能对人类的心理健康造成巨大影响

更重要的是,如果越来越多的自动化已经对就业造成巨大影响,这也会对人们的心理健康产生负面影响。生物伦理学家、奥巴马总统前医疗顾问伊齐基尔·伊曼纽尔(EzekielEmanuel)表示:“如果你思考下能让人们的生活变得有意义的东西,你会发现三件事:有意义的人际关系、强烈的兴趣以及有意义的工作。其中有意义的工作是定义某人生活的重要因素。在有些地区,当工厂关门时失去工作,可能导致自杀、药物滥用以及抑郁症危险的增加。”

结果,我们可能需要看到更多的伦理需求。麻省理工学院专供法律和道德的专家凯特·达灵(KateDarling)认为:“公司正遵循市场激励机制,这不是坏事,但我们不能仅仅依赖于伦理道德来控制它。它有助于监管到位,我们已经在隐私以及新技术领域看到它的存在,我们需要找出应对的方法。”

达灵指出,许多大牌公司(比如谷歌)已经成立道德委员会,来监督AI的开发和部署。有人认为,这种机制应该被广泛采用。达灵说:“我们不想扼杀创新,但到达某种程度时,我们可能想要创造某种结构。”

到底谁能入选谷歌道德委员会以及它到底能做什么,这些细节还所知甚少。但在2016年9月份,Facebook、谷歌以及亚马逊成立了联合组织,目标是寻找应对AI带来的安全与隐私威胁的解决方案。OpenAI也是类似的组织,旨在开发和推广能够让所有人受益的开源AI。谷歌的诺维格说:“机器学习技术被公开研究,并通过开放出版物和开源代码传播非常重要,我们可以分享所有奖励。”

如果我们能够制定行业标准和道德标准,并全面了解AI存在的风险,然后建立以伦理学家、技术专家以及企业领导人为核心的监管机制非常重要。这是利用AI为人类谋福利的最佳方式。斯特兰说:“我们的工作是减少人们对科幻电影中机器人接管世界的担忧,更多关注技术如何能够被用于帮助人类思考和决策,而非完全取代它。”

(文章来源:网易科技)

第三十八届CIO班招生

国际CIO认证培训

首席数据官(CDO)认证培训

责编:houlimin

免责声明:本网站(http://www.ciotimes.com/)内容主要来自原创、合作媒体供稿和第三方投稿,凡在本网站出现的信息,均仅供参考。本网站将尽力确保所提供信息的准确性及可靠性,但不保证有关资料的准确性及可靠性,读者在使用前请进一步核实,并对任何自主决定的行为负责。本网站对有关资料所引致的错误、不确或遗漏,概不负任何法律责任。

本网站刊载的所有内容(包括但不仅限文字、图片、LOGO、音频、视频、软件、程序等)版权归原作者所有。任何单位或个人认为本网站中的内容可能涉嫌侵犯其知识产权或存在不实内容时,请及时通知本站,予以删除。