ChatGPT“风口”下,AI算力会打破摩尔定律吗?| 原创

ChatGPT“风口”下,AI算力会打破摩尔定律吗?| 原创

2023-12-22 09:41:31 来源: 抢沙发

抢沙发

2023-12-22 09:41:31 来源:

摘要:以生成式AI为主导的人工智能正在迅速发展,它究竟发展得有多快?背后支撑这一速度的动力又是什么?其实,除了目前业界都关注的算力芯片方面之外,机器学习算法及AI算法的改进速度也至关重要。

关键词:

AI

算力

ChatGPT

摩尔定律

原创专栏

以生成式AI为主导的人工智能正在迅速发展,它究竟发展得有多快?背后支撑这一速度的动力又是什么?其实,除了目前业界都关注的算力芯片方面之外,机器学习算法及AI算法的改进速度也至关重要。

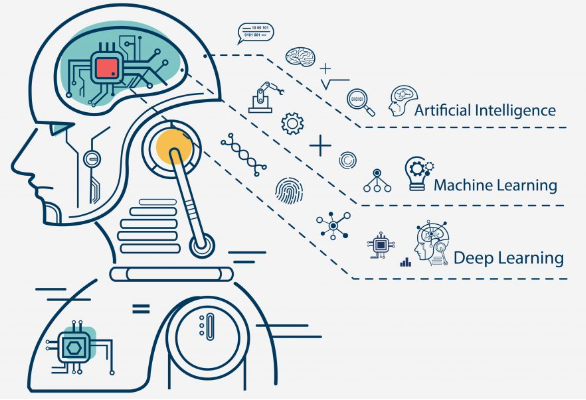

(图源:siliconangle)

ChatGPT“风口”下,算力需求大爆发

ChatGPT 引领的AI大模型大潮下,科技巨头及大批新兴企业争先涌入大模型赛道。随着模型的增加,生成性AI应用的算力需求可谓指数级增长。

(图源:research.aimultiple)

据科技部新一代人工智能发展研究中心发布的《中国人工智能大模型地图研究报告》显示,截至今年5月份,我国10亿参数规模以上的大模型已发布79个,8月份该数据已超过110个,国内研发的大模型数量排名全球第二。大模型的火热发展,让相对应的AI算力也面临了严峻的挑战。

过去的十年里,AI的每一点突破都清晰可见,这也是由于其对指数级增长的计算能力需求驱动的结果。但现在,这种增长速度已经不能长期维持了。

当前,很多大模型的参数量已经超过了万亿规模,模型参数量的进一步增加,让GPU算力也随之成倍增加。这就意味着,需要更大规模的算力平台,才能进行如此规模大模型的训练。

生成式AI崛起带来的挑战

业内人士认为,人们对于AI系统的训练,可分为3个不同的时代。第一阶段从20世纪50年代持续到了21世纪末,依赖有限的计算资源和简单的算法来对AI系统进行训练,AI技术发展有了不断的突破。相比之下,第二个阶段也就是现代阶段始于2012年左右,随着深度学习的兴起,以及GPU和TPU等强大硬件的可用性,训练数百万甚至数十亿个参数的复杂模型越来越普遍。第三个阶段,即当前时代——始于2016年左右的AlphaGo,一直到今天的ChatGPT。

随着ChatGPT为主导的AI大模型技术崛起,算力需求迎来大爆发。

AI大模型是由深度学习发展的推动演变而来的,深度学习让这些模型能从大量数据中学习并准确地进行预测及决策。当前AI模型前所未有的庞大规模和复杂性,同样需要前所未有的计算能力来训练和操作。

面对算力挑战,AI方面软硬件的新突破,则有助于释放人工智能的全部潜力。比如GPU(图形处理单元)和TPU(张量处理单元)专用硬件,已成为训练人工智能模型的强大工具,分布式计算架构也正在开发中,以便可以支持多台机器无缝协同工作。

AI模型的复杂性不断增加,其对可扩展和高效计算资源的需求也会继续增长。这就需要业界开发者和工程师们共同努力,不断开发创新硬件和软件解决方案,以跟上人工智能的快速发展,为智能自动化、预测分析和其他变革性应用开启新的可能性。

一场关于AI的算力竞赛已经开始,生成式AI爆火下的AI算力会否遵循“摩尔定律”呢?

AIGC崛起,AI算力会否突破摩尔定律?

摩尔定律始于已故英特尔联合创始人Gordon · Moore的随机观察,即当价格不变时,集成电路上可容纳的晶体管数目,约每隔18-24个月便会增加一倍,性能也将提升一倍。在过去的60多年的时间里,摩尔定律已经得到了证实。

业界普遍认为,驱动机器学习发展的三要素——可用的算力、数据以及算法。其中,算力相比而言会更加有迹可循,比如芯片研发等方面不断迭代升级,但算法的改进却是这三要素中最难以捉摸的。

作为另类的机器学习模型,生成式AI所处的机器学习领域是否也存在一种有关算法的摩尔定律?

在过去的十年里,业界围绕AI及机器学习算法的相关跟踪研究就没有停止过。此前,业界AI巨头OpenAI就通过轨迹跟踪算法(一种用于跟踪物体的算法,它可以跟踪物体的位置、速度和方向,通常使用视频图像序列来实现,比如一组连续的摄像头图像 ),发现了AI机器学习效率的规律,并试图量化其增长的速度。

早在2012年的相关论文中,OpenAI就展示了AI在训练过程中所需的惊人算力,同样惊人的还有算力资源的增长速度。为了量化进展,OpenAI的研究人员于2020年选择了基准图像识别算法(AlexNet)进行跟踪,发现了其算法效率每16个月翻一番。

也就是说,芯片性能的摩尔定律所预测的周期每18个月会翻一倍,而AI算法性能则是每16个月翻一倍,已经超过了摩尔定律。与此同时,和2012年相比,2019年的图像识别AI所需的计算量仅为原来的1/44。

(图源:singularityhub)

要知道在2012年之前,AI使用的算力增长主要遵循摩尔定律,但自从2012年以来,AI机器学习算法使用的算力增长速度已是摩尔定律的7倍。

当然,“AI机器学习效率已超过摩尔定律”这一结论,是聚焦于深度学习算法的,那么它能否适用于目前的AIGC浪潮下的人工智能领域,这依旧是个问题。

好在,一直以来OpenAI对跟踪AI算法进展相当感兴趣,以至于后来他们不断增加学术研究人才及资金等投入,直到2022年底“ChatGPT”横空出世,生成式AI为代表的人工智能正式迎来了算力需求大爆发的时代。

尽管以上OpenAI针对算法效率的测量仍存在局限性,比如通过改进算法来影响训练运行的空间,再加上数据点较少,因此“AI算力突破摩尔定律”这一问题仍待商榷,但是让我们意识到,距离该问题的答案已经越来越近了。

编辑 | MissD

·END·

第三十八届CIO班招生

国际CIO认证培训

首席数据官(CDO)认证培训

责编:zhanghy

免责声明:本网站(http://www.ciotimes.com/)内容主要来自原创、合作媒体供稿和第三方投稿,凡在本网站出现的信息,均仅供参考。本网站将尽力确保所提供信息的准确性及可靠性,但不保证有关资料的准确性及可靠性,读者在使用前请进一步核实,并对任何自主决定的行为负责。本网站对有关资料所引致的错误、不确或遗漏,概不负任何法律责任。

本网站刊载的所有内容(包括但不仅限文字、图片、LOGO、音频、视频、软件、程序等)版权归原作者所有。任何单位或个人认为本网站中的内容可能涉嫌侵犯其知识产权或存在不实内容时,请及时通知本站,予以删除。